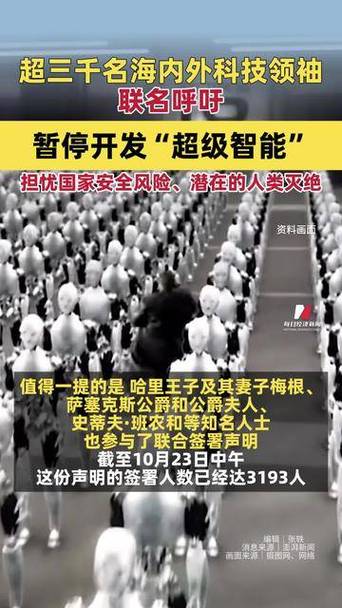

顶级专家联合呼吁,暂停超级智能研发的紧急行动

暂停超级智能研发

在当今科技飞速发展的时代,人工智能的浪潮席卷全球,一群顶级科技大佬近日发出共同呼声,呼吁全球范围内暂停超级智能研发的进度,这一观点引发了社会各界的广泛关注与热议。

超级智能研发的争议背景

随着人工智能技术的不断进步,超级智能的研发逐渐成为科技领域的焦点,在这一领域取得巨大成就的顶级科学家们却对超级智能的发展表示担忧,他们认为,当前阶段的超级智能技术可能带来潜在风险,对人类社会的未来发展构成挑战,他们呼吁全球范围内暂停超级智能研发,以便更深入地探讨其潜在风险并制定相应的应对策略。

顶级大佬的呼吁与观点

这些顶级大佬包括人工智能领域的先驱和多位诺贝尔奖得主,他们认为,虽然超级智能技术在理论上具有巨大的潜力,但目前的技术发展尚未成熟,超级智能的应用可能引发一系列伦理、法律和社会问题,如人类失业、隐私泄露和决策权失衡等,他们呼吁全球科技界暂时搁置超级智能的研发工作,转而集中力量解决当前的技术挑战和潜在风险。

潜在风险分析

超级智能技术的潜在风险不容忽视,技术风险方面,当前的人工智能技术尚未完全成熟,存在算法缺陷和不可预测性等问题,伦理风险方面,超级智能可能加剧社会不平等现象,导致人类与机器之间的伦理冲突,政治和经济风险同样不容忽视,超级智能技术的运用可能引发新的地缘政治冲突和经济波动,在全面评估这些潜在风险之前,暂停超级智能研发是必要的。

全球社会的反响

顶级大佬的呼吁引起了全球社会的广泛关注,支持者认为这是一个明智的决策,有助于避免潜在风险并确保人工智能的健康发展,也有一些人持反对意见,他们认为暂停研发可能导致竞争优势的丧失和技术进步受阻,一些企业和研究机构已经开始探索应对潜在风险的策略和方法,以确保在暂停期间继续推进相关研究工作。

尽管存在争议,但顶级大佬呼吁暂停超级智能研发的行动提醒我们,科技进步不应忽视潜在风险和社会影响,全球科技界和社会各界需要共同努力,制定更加全面和科学的评估体系,以确保人工智能技术的健康发展,我们也需要加强国际合作与交流,共同应对超级智能技术带来的挑战与机遇,只有在充分考虑各种因素的基础上,我们才能确保科技进步真正造福人类社会。